Außergewöhnliche Leistung

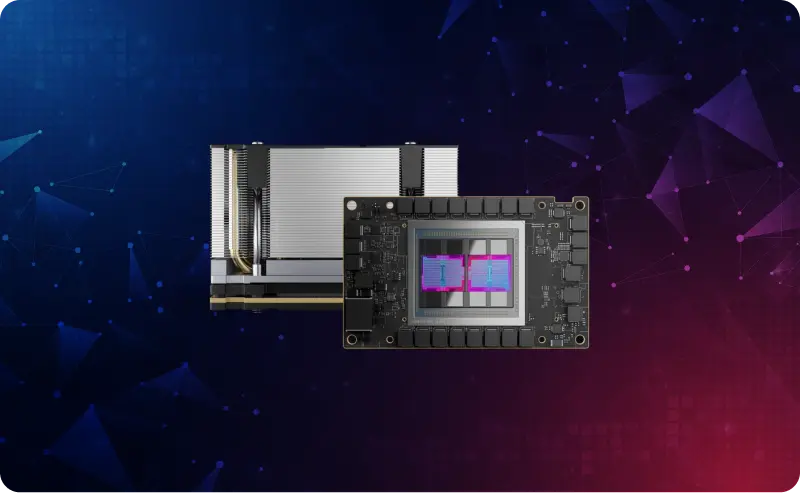

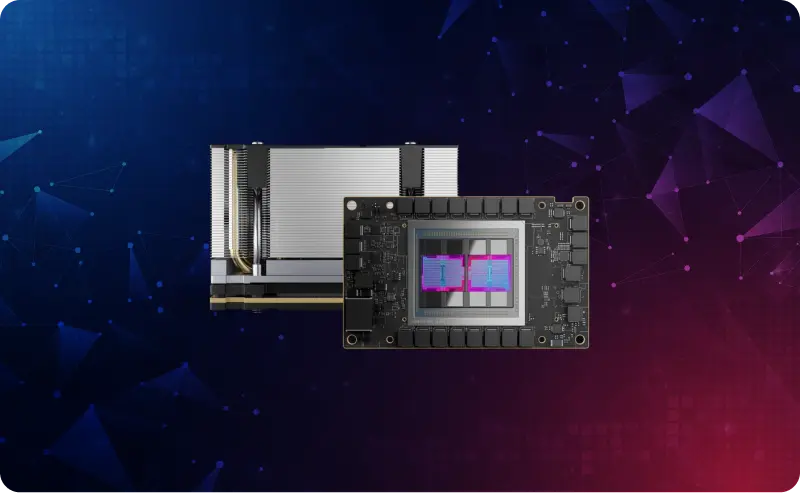

Die auf der revolutionären CDNA3-Architektur basierende MI300A APU zeichnet sich durch eine unvergleichliche Rechenleistung aus und ist damit perfekt für anspruchsvollste KI- und HPC-Workloads geeignet.

Optimieren Sie Ihre Machine-Learning- und LLM-Workloads mit dedizierten HPE-Servern der Enterprise-Klasse, die auf AMD Instinct basieren.

Besitzen Sie ungenutzte Server- oder Desktop-GPU-Setups? Stellen Sie diese noch heute auf dem Primcast-Marktplatz ein und verdienen Sie regelmäßige monatliche Mieteinnahmen von KI-Teams, Entwicklern und Unternehmen, die Rechenleistung in Produktionsqualität benötigen.

Speziell entwickelt für KI, maschinelles Lernen und umfangreiche Sprachmodell-Workloads. Unsere AMD Instinct GPU-Server bieten außergewöhnliche Rechenleistung mit HBM3-Speicher, CDNA3-Architektur und Zen 4-CPU-Kernen für anspruchsvolle KI/HPC-Anwendungen.

Die auf der revolutionären CDNA3-Architektur basierende MI300A APU zeichnet sich durch eine unvergleichliche Rechenleistung aus und ist damit perfekt für anspruchsvollste KI- und HPC-Workloads geeignet.

Die Integration von AMD Instinct-Beschleunigern mit EPYC™ Zen 4 CPU-Kernen (24 Kerne) verbessert Effizienz, Flexibilität und Programmierbarkeit und beseitigt gleichzeitig Verzögerungen bei der Datenübertragung.

Entscheiden Sie sich für einen Hochleistungsserver mit AMD Instinct MI300A APU, der speziell für skalierbare Anforderungen entwickelt wurde und über eine beeindruckende HBM3-Speicherkapazität von 192 GB verfügt.

Hochleistungsbeschleuniger, die für Exascale-HPC- und KI-Workloads entwickelt wurden

Der AMD Instinct MI250X ist der ideale Beschleuniger für HPC-Workloads und wurde speziell für das Exascale-Computing-Zeitalter entwickelt.

Der AMD Instinct MI250-Beschleuniger bietet eine unübertroffene Leistung für HPC- und KI-Anwendungen und ist damit ein unschätzbarer Gewinn für Unternehmen, Forschungs- und akademische Einrichtungen.

Der AMD Instinct MI210 Accelerator verbessert die HPC- und KI-Fähigkeiten und ist speziell für Forschungs-, akademische und Geschäftsumgebungen konzipiert. Er eignet sich sowohl für Einzelserver- als auch für größere Lösungen.

Die AMD Instinct™ MI200-Serie, die auf der AMD CDNA™-Architektur der 2. Generation basiert, nutzt ein Multi-Chip-Design für maximalen Durchsatz und Energieeffizienz bei anspruchsvollen HPC- und KI-Workloads.

Mit fortschrittlichen KI-Funktionen beschleunigt Ihr dedizierter M200-Server das Training und die Inferenz von Deep Learning und bietet leistungsstarke Lösungen für KI-basierte Projekte.

Mit der zweiten CDNA™-Architektur und der dritten Infinity-Architektur integrieren diese Server CPU- und GPU-Ressourcen nahtlos und maximieren so die Systemeffizienz und den Durchsatz.

Server, die mit AMD Instinct MI200-Serienbeschleunigern ausgestattet sind, bieten fortschrittliche Peer-to-Peer-Konnektivität mit bis zu 8 AMD Infinity Fabric™-Verbindungen und gewährleisten so einen nahtlosen und effizienten Datentransfer für anspruchsvolle Workloads.

Ihr dedizierter Server mit AMD INSTINCT™ GPU wird von HPE Enterprise-Servern unterstützt und gewährleistet so eine stabile Leistung auch bei anspruchsvollsten Workloads.

Erweitern Sie Ihre Serverinfrastruktur unkompliziert um Ressourcen oder zusätzliche Server. Die meisten Upgrades werden innerhalb von 24 Stunden verarbeitet.

Unsere Experten für dedizierte Server stehen Ihnen rund um die Uhr per Live-Chat und E-Mail zur Verfügung.

| MI210 | L40S | A100 | H100 | |

|---|---|---|---|---|

| GPU-Architektur | CDNA 2.0 | Ada Lovelace | NVIDIA Ampere | Trichter |

| GPU-Speicher | 64 GB HBM2e | 48 GB GDDR6 | 80 GB HBM2e | 80 GB HBM3 |

| GPU-Speicherbandbreite | 1638 GB/s | 864 GB/s | 1935 GB/s | 3352 GB/s |

| FP32 | 22,63 TFLOPS | 91,6 TFLOPS | 19,5 TFLOPS | 51 TFLOPS |

| TF32 Tensor Core | 312 TFLOPS | 366 TFLOPS | 312 TFLOPS | 756 TFLOPS |

| FP16/BF16 Tensor Core | 181 TFLOPS | 733 TFLOPS | 624 TFLOPS | 1513 TFLOPS |

| Leistung | Bis zu 300 W | Bis zu 350 W | Bis zu 400 W | Bis zu 350 W |

| Laden... | Laden... | Laden... | Laden... |

Häufig gestellte Fragen zur Bereitstellung und Verwaltung Ihrer AMD Instinct GPU-beschleunigten Server für KI-, HPC- und Machine-Learning-Workloads.

AMD Instinct GPUs sind Hochleistungsbeschleuniger, die speziell für künstliche Intelligenz, maschinelles Lernen, große Sprachmodelle (LLMs) und High-Performance-Computing-Anwendungen (HPC) entwickelt wurden. Sie eignen sich hervorragend für Deep-Learning-Training und -Inferenz, wissenschaftliche Simulationen, Datenanalyse und computergestützte Forschung. Die CDNA-Architektur ist für rechenintensive Parallelverarbeitung und nicht für Grafikrendering optimiert.

Die MI300A ist AMDs neueste APU, die den AMD Instinct-Beschleuniger mit AMD EPYC™ Zen 4-CPU-Kernen (24 Kerne) auf einem einzigen Chip integriert. Sie verfügt über 192 GB HBM3-Speicher und die AMD Infinity-Architektur der 3. Generation. Die MI200-Serie (MI250X, MI250, MI210) umfasst dedizierte GPU-Beschleuniger auf Basis der CDNA-Architektur der 2. Generation mit Multi-Chip-Design. Die MI300A bietet eine einheitliche Speicherarchitektur, die Verzögerungen beim Datentransfer zwischen CPU und GPU eliminiert, während die MI200-Serie über AMD Infinity Fabric™-Verbindungen eine außergewöhnliche Peer-to-Peer-Konnektivität ermöglicht.

Ihr dedizierter AMD Instinct-Server wird in der Regel innerhalb von 3–10 Minuten nach Zahlungseingang aktiviert (bei Servern mit sofortiger Bereitstellung). Bei kundenspezifischen Konfigurationen variiert die Bereitstellungszeit je nach Hardwareverfügbarkeit. Alle Server bieten die Möglichkeit zum sofortigen Neuladen des Betriebssystems, sodass Sie schnell iterieren können, ohne erneut Support-Tickets öffnen zu müssen. Unsere Netzwerkrouten sind für permanente Workloads und hohe Datenübertragungsraten optimiert.

AMD Instinct GPUs sind vollständig kompatibel mit ROCm (Radeon Open Compute), AMDs Open-Source-Softwareplattform für GPU-Computing. Sie unterstützen gängige Frameworks wie PyTorch, TensorFlow, JAX und ONNX Runtime. ROCm bietet HIP (Heterogeneous-Compute Interface for Portability) für die einfache Migration von CUDA-Code sowie optimierte Bibliotheken für BLAS, FFT, RNG und Deep-Learning-Primitive. Die Plattform unterstützt containerisierte Workflows mit Docker und Kubernetes für skalierbare KI/ML-Implementierungen.

Der AMD Instinct MI300A verfügt über 192 GB HBM3 (High Bandwidth Memory) mit außergewöhnlicher Speicherbandbreite für datenintensive Anwendungen. Die Beschleuniger der MI200-Serie bieten HBM2e-Speicherkonfigurationen mit hoher Bandbreite, optimiert für umfangreiche KI-Modelle und HPC-Anwendungen. Diese hohe Speicherkapazität ermöglicht das Training großer Sprachmodelle, die Verarbeitung massiver Datensätze und die Durchführung komplexer Simulationen ohne häufige Datentransfers zwischen Host- und Beschleunigerspeicher.