Servers in stock

Checking availability...

-

Configurações Nvidia A100 H100, perfeitas para IA, aprendizado profundo, visualização e computação de alto desempenho.

Discos NVMe

Suporte 24 horas por dia, 7 dias por semana

Preços imbatíveis

Implantação em 5 minutos

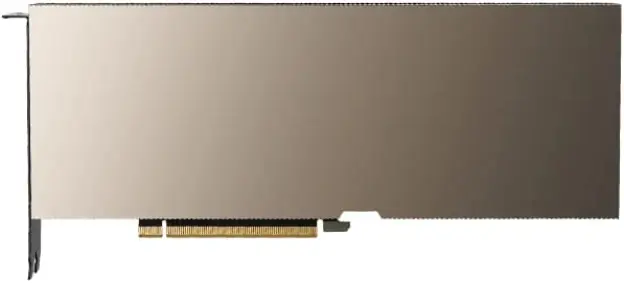

GPU NVIDIA A100

| Especificações da NVIDIA A100: | |

|---|---|

| Capacidade de memória de vídeo | 40 GB / 80 GB HBM2 |

| núcleos CUDA | 6912 peças. |

| Largura de banda máxima | 1,6 TB/s |

| As GPUs Nvidia A100 oferecem o desempenho, a escalabilidade e a eficiência necessários para aplicações de IA e aprendizado profundo, tornando-as uma excelente opção para empresas e pesquisadores que buscam poder computacional de ponta. | |

Infraestrutura Ampere

Com 54 bilhões de transistores, a arquitetura NVIDIA Ampere é um dos maiores chips de 7 nanômetros já construídos.

Memória de alta largura de banda (HBM2)

A HBM2 foi projetada para oferecer acesso rápido e eficaz aos dados, com largura de banda de memória de até 1,6 TB/s.

IA e Aprendizado Profundo

A Nvidia A100 foi projetada especificamente para aplicações de inteligência artificial e aprendizado profundo, oferecendo até 20 vezes o desempenho das GPUs da geração anterior.

Traçado de raios

Experimente o ray tracing em tempo real, ideal para tarefas de visualização exigentes. A GPU A100 oferece a potência de renderização necessária para visuais realistas e imersivos.

Suporte NVLink

Utilize os recursos do NVLink de 3ª geração para transferências de dados ultrarrápidas, até 10 a 20 vezes mais rápidas que o PCI-Express.

GPU multi-interface

Permita que cada GPU A100 execute simultaneamente sete aplicativos ou sessões de usuário distintos e isolados.

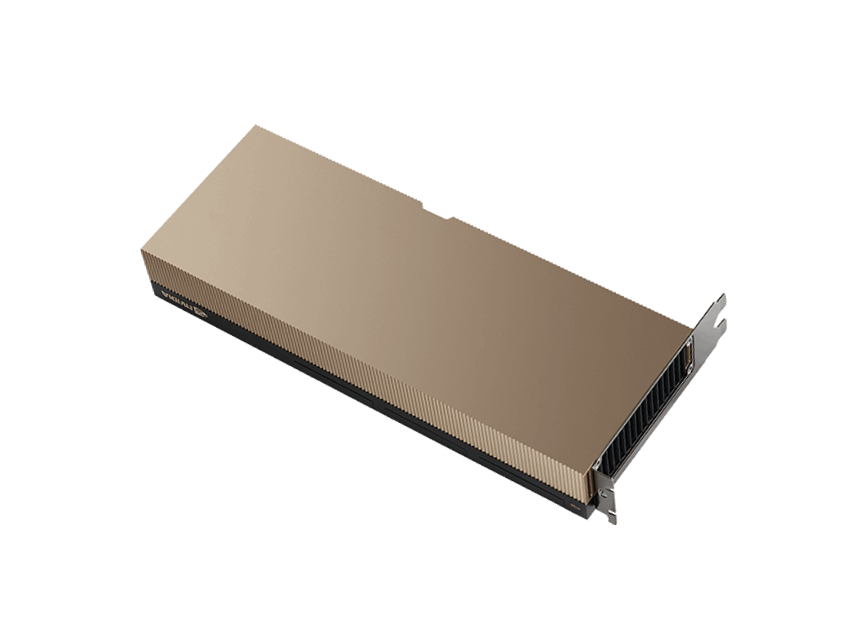

GPU NVIDIA H100

| Especificações da NVIDIA H100: | |

|---|---|

| Capacidade de memória de vídeo | 80 GB HBM3 |

| núcleos CUDA | 8448 peças. |

| Largura de banda máxima | 3 TB/s |

| A mais recente GPU NVIDIA H100 oferece desempenho, escalabilidade e segurança sem precedentes para diversas cargas de trabalho. Ela é pelo menos duas vezes mais rápida que sua antecessora, a GPU A100. | |

Infraestrutura de funil

As GPUs H100 oferecem desempenho excepcional em aplicações HPC, com desempenho 7 vezes superior em comparação com a GPU A100.

Conectividade

É possível conectar até 256 GPUs H100 usando o sistema de comutação NVIDIA NVLink, permitindo a aceleração de tarefas em exaescala.

Treinamento de IA

A GPU H100 representa a quarta geração do sistema de IA mais avançado, oferecendo recursos de desempenho excepcionais.

GPU multi-interface

O H100 apresenta a tecnologia MIG de segunda geração, que permite que cada GPU seja particionada com segurança em até sete instâncias separadas.

Por que Primcast?

Entrega rápida

As configurações instantâneas do A100 são entregues em até 5 minutos, após a confirmação do seu pagamento.

99,9% sla

Seu servidor dedicado com GPU conta com o respaldo de um SLA líder do setor, com 99,9% de tempo de atividade.

Suporte 24 horas por dia, 7 dias por semana

Especialistas em nuvem com GPUs ao vivo estão disponíveis via chat ao vivo, telefone e e-mail.

Centros de dados

Implante seu servidor dedicado NVIDIA A100 a partir de Nova York, Miami, São Francisco, Amsterdã ou Bucareste.