卓越的表现

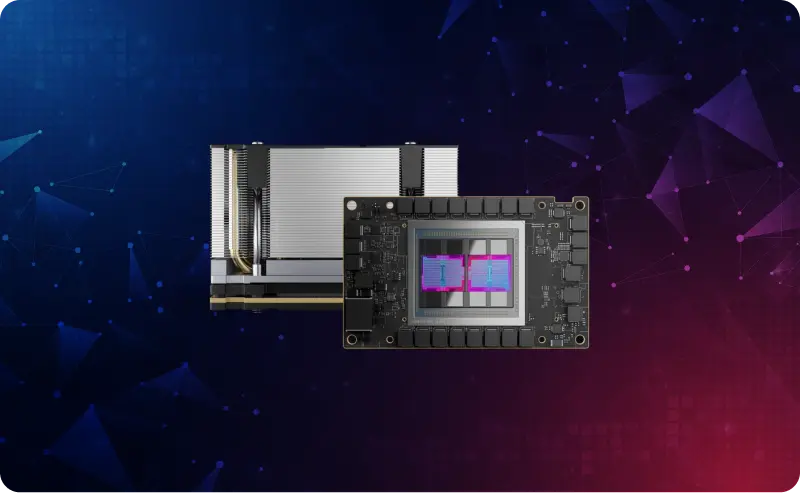

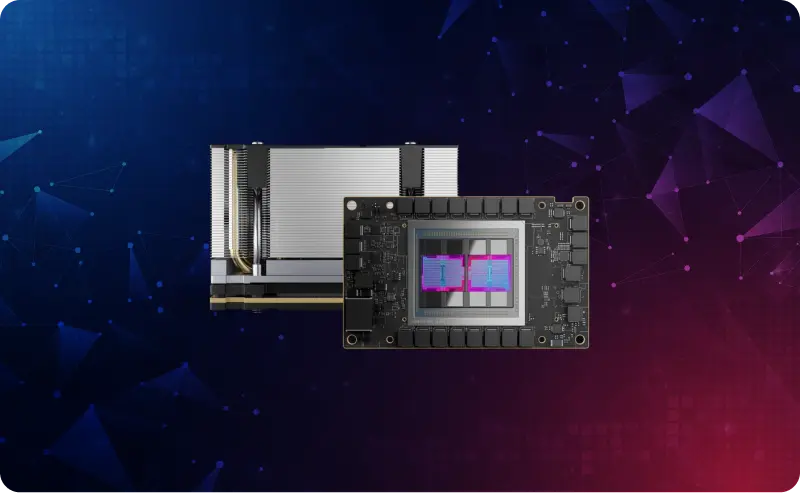

MI300A APU 基于革命性的 CDNA3 架构,在提供无与伦比的计算性能方面表现出色,非常适合要求最苛刻的 AI 和 HPC 工作负载。

使用由 AMD Instinct 提供支持的 HPE 企业级专用服务器,优化您的机器学习和 LLM 工作负载。

有闲置的服务器或桌面 GPU 配置吗?立即在 Primcast 市场上架,即可从需要生产级计算的 AI 团队、开发人员和企业那里获得稳定的月租金。

专为人工智能、机器学习和大型语言模型工作负载而打造。我们的 AMD Instinct GPU 服务器采用 HBM3 内存、CDNA3 架构和 Zen 4 CPU 内核,为要求苛刻的 AI/HPC 应用提供卓越的计算密度。

MI300A APU 基于革命性的 CDNA3 架构,在提供无与伦比的计算性能方面表现出色,非常适合要求最苛刻的 AI 和 HPC 工作负载。

AMD Instinct 加速器与 EPYC™ Zen 4 CPU 内核(24 个内核)的集成提高了效率、灵活性和可编程性,同时消除了数据传输延迟。

选择配备 AMD Instinct MI300A APU 的高性能服务器,该服务器专为满足可扩展性需求而设计,并拥有令人印象深刻的 192GB HBM3 内存容量。

专为百亿亿次级高性能计算和人工智能工作负载设计的高性能加速器

AMD Instinct MI250X 是高性能计算工作负载的理想加速器,专为百亿亿次级计算时代而设计。

AMD Instinct MI250 加速器为高性能计算和人工智能应用提供了无与伦比的性能,使其成为企业、研究机构和学术机构的宝贵资产。

AMD Instinct MI210 加速器增强了高性能计算和人工智能能力,专为研究、学术和商业环境量身打造,可承载单服务器和大型解决方案。

AMD Instinct™ MI200 系列采用第二代 AMD CDNA™ 架构,利用多芯片设计,可在要求苛刻的 HPC 和 AI 工作负载中实现最大吞吐量和能效。

凭借先进的人工智能功能,您的 M200 专用服务器可加速深度学习训练和推理,为基于人工智能的项目提供强大的解决方案。

这些服务器采用第二代 CDNA™ 架构和第三代 Infinity 架构,无缝集成 CPU 和 GPU 资源,最大限度地提高系统效率和吞吐量。

配备 AMD Instinct MI200 系列加速器的服务器提供先进的点对点连接,最多可连接 8 个 AMD Infinity Fabric™ 链路,确保为高要求的工作负载提供无缝、高效的数据传输。

您的 AMD INSTINCT™ GPU 专用服务器由 HPE 企业级服务器提供支持,可确保为最苛刻的工作负载提供稳定的性能。

轻松为您的服务器基础架构添加资源或额外服务器。大多数升级会在 24 小时内完成。

我们有专业的服务器专家团队,可通过在线聊天和电子邮件全天候为您提供帮助。

| MI210 | L40S | A100 | H100 | |

|---|---|---|---|---|

| GPU架构 | CDNA 2.0 | 艾达·洛夫莱斯 | NVIDIA Ampere | 料斗 |

| GPU 显存 | 64GB HBM2e | 48GB GDDR6 | 80GB HBM2e | 80GB HBM3 |

| GPU内存带宽 | 1638 GB/s | 864 GB/s | 1935 GB/s | 3352 GB/s |

| FP32 | 22.63 TFLOPS | 91.6 TFLOPS | 19.5 TFLOPS | 51 TFLOPS |

| TF32 张量核心 | 312 TFLOPS | 366 TFLOPS | 312 TFLOPS | 756 TFLOPS |

| FP16/BF16 张量核心 | 181 TFLOPS | 733 TFLOPS | 624 TFLOPS | 1513 TFLOPS |

| 力量 | 最高可达 300 瓦 | 最高可达 350 瓦 | 最高可达 400 瓦 | 最高可达 350 瓦 |

| 加载中... | 加载中... | 加载中... | 加载中... |

关于部署和管理用于 AI、HPC 和机器学习工作负载的 AMD Instinct GPU 加速服务器的常见问题。

AMD Instinct GPU 是专为人工智能、机器学习、大型语言模型 (LLM) 和高性能计算 (HPC) 工作负载而设计的高性能加速器。它们在深度学习训练和推理、科学模拟、数据分析和计算研究方面表现出色。CDNA 架构针对计算密集型并行处理进行了优化,而非图形渲染。

MI300A 是 AMD 最新推出的 APU,它将 AMD Instinct 加速器与 AMD EPYC™ Zen 4 CPU 核心(24 个核心)集成于单芯片上,配备 192GB HBM3 显存和第三代 AMD Infinity 架构。MI200 系列(MI250X、MI250、MI210)是基于第二代 CDNA 架构的专用 GPU 加速器,采用多芯片设计。MI300A 采用统一的内存架构,消除了 CPU 和 GPU 之间的数据传输延迟,而 MI200 系列则通过 AMD Infinity Fabric™ 互连提供卓越的点对点连接性能。

对于即时交付服务器,您的 AMD Instinct 专用服务器通常会在付款到账后的 3-10 分钟内激活。对于定制配置,部署时间取决于硬件可用性。所有服务器均具备即时操作系统重装功能,让您可以快速迭代,无需重新提交支持工单。我们的网络路由针对持续在线工作负载和高吞吐量数据传输进行了优化。

AMD Instinct GPU 与 ROCm(Radeon Open Compute)完全兼容,ROCm 是 AMD 的开源 GPU 计算软件平台。它们支持包括 PyTorch、TensorFlow、JAX 和 ONNX Runtime 在内的常用框架。ROCm 提供 HIP(异构计算接口,用于可移植性),方便 CUDA 代码迁移,并提供针对 BLAS、FFT、RNG 和深度学习原语的优化库。该平台支持使用 Docker 和 Kubernetes 进行容器化工作流,以实现可扩展的 AI/ML 部署。

AMD Instinct MI300A 配备 192GB HBM3(高带宽内存),拥有卓越的内存带宽,可满足数据密集型工作负载的需求。MI200 系列加速器提供高带宽 HBM2e 内存配置,针对大规模 AI 模型和高性能计算 (HPC) 应用进行了优化。这种高内存容量支持训练大型语言模型、处理海量数据集以及运行复杂的模拟,而无需在主机和加速器内存之间频繁传输数据。