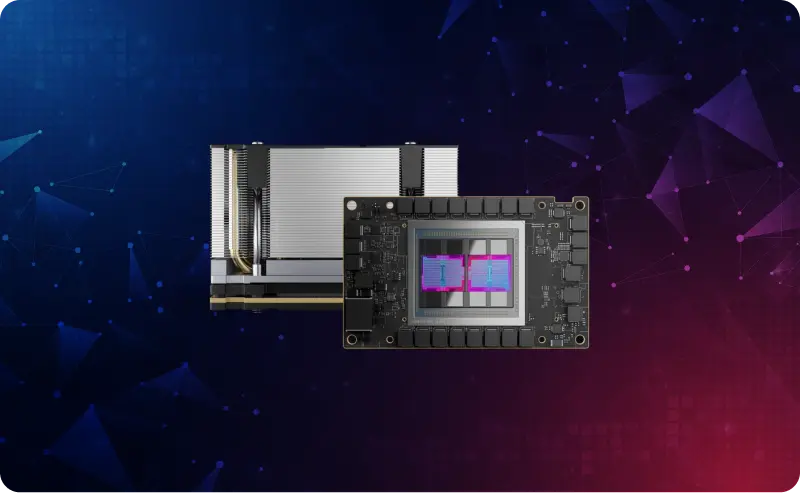

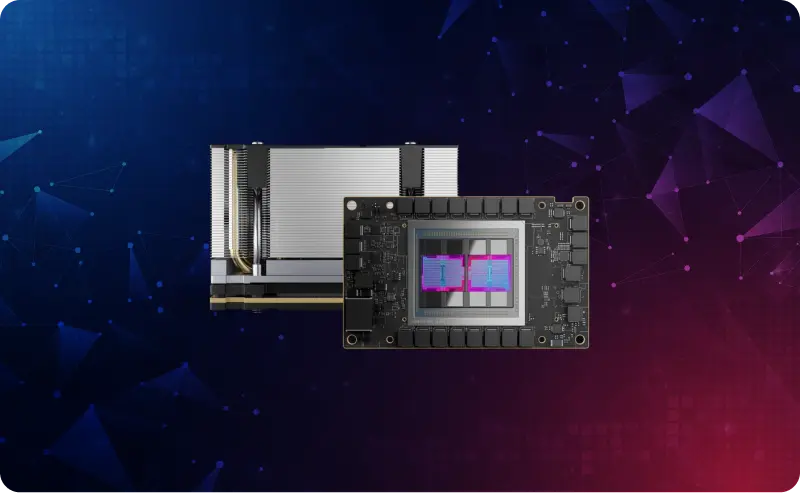

Wyjątkowa wydajność

Zbudowany na bazie rewolucyjnej architektury CDNA3 procesor APU MI300A wyróżnia się niezrównaną wydajnością obliczeniową, idealną do najbardziej wymagających zadań z zakresu sztucznej inteligencji i obliczeń o wysokiej wydajności (HPC).