Olağanüstü performans

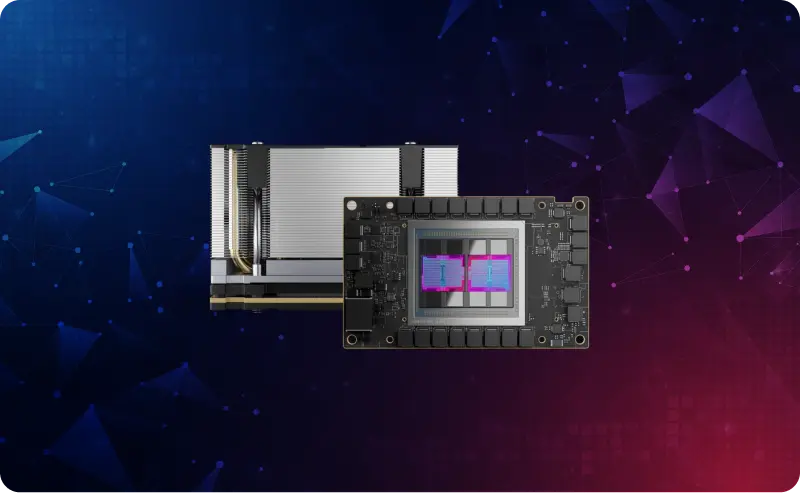

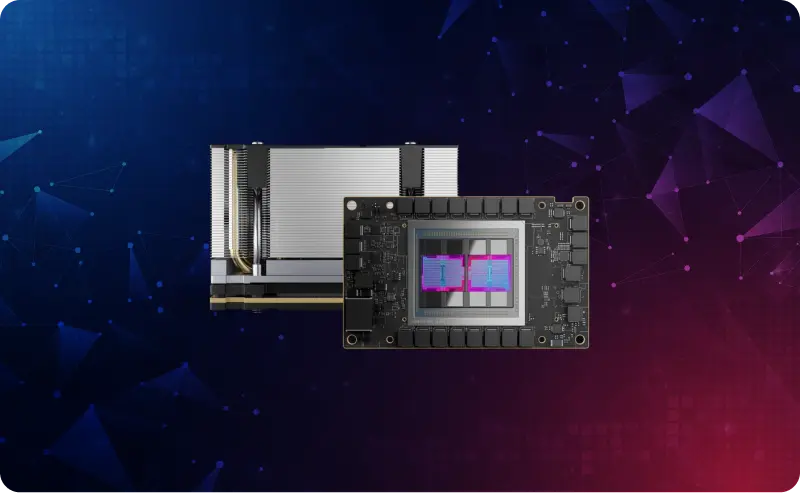

Devrim niteliğindeki CDNA3 mimarisi üzerine inşa edilen MI300A APU, en zorlu yapay zeka ve yüksek performanslı bilgi işlem iş yükleri için mükemmel olan, benzersiz bilgi işlem performansı sunmada üstünlük gösterir.

AMD Instinct tarafından desteklenen HPE kurumsal sınıf özel sunucuları ile Makine Öğrenimi ve LLM iş yüklerinizi optimize edin.

Kullanılmayan sunucu veya masaüstü GPU kurulumlarınız mı var? Bunları bugün Primcast pazar yerinde listeleyin ve üretim kalitesinde işlem gücüne ihtiyaç duyan yapay zeka ekiplerinden, geliştiricilerden ve işletmelerden düzenli aylık kira geliri elde edin.

Yapay zeka, makine öğrenimi ve büyük dil modeli iş yükleri için özel olarak tasarlanmıştır. AMD Instinct GPU sunucularımız, zorlu yapay zeka/yüksek performanslı bilgi işlem uygulamaları için HBM3 bellek, CDNA3 mimarisi ve Zen 4 CPU çekirdekleriyle olağanüstü işlem yoğunluğu sunar.

Devrim niteliğindeki CDNA3 mimarisi üzerine inşa edilen MI300A APU, en zorlu yapay zeka ve yüksek performanslı bilgi işlem iş yükleri için mükemmel olan, benzersiz bilgi işlem performansı sunmada üstünlük gösterir.

AMD Instinct hızlandırıcılarının EPYC™ Zen 4 CPU çekirdekleriyle (24 çekirdek) entegrasyonu, veri aktarım gecikmelerini ortadan kaldırırken verimliliği, esnekliği ve programlanabilirliği artırır.

Ölçeklenebilir gereksinimleri karşılamak üzere tasarlanmış, etkileyici 192 GB HBM3 bellek kapasitesine sahip, AMD Instinct MI300A APU ile donatılmış yüksek performanslı bir sunucu seçin.

Eksa ölçekli yüksek performanslı hesaplama ve yapay zeka iş yükleri için tasarlanmış yüksek performanslı hızlandırıcılar.

AMD Instinct MI250X, özellikle eksa ölçekli hesaplama çağı için tasarlanmış, yüksek performanslı hesaplama (HPC) iş yükleri için ideal bir hızlandırıcıdır.

AMD Instinct MI250 hızlandırıcı, yüksek performanslı bilgi işlem (HPC) ve yapay zeka (AI) uygulamaları için eşsiz bir performans sunarak işletmeler, araştırma ve akademik kurumlar için paha biçilmez bir varlık haline geliyor.

Yüksek performanslı bilgi işlem (HPC) ve yapay zeka (AI) yeteneklerini geliştiren AMD Instinct MI210 Hızlandırıcı, hem tek sunuculu hem de daha büyük çözümlere ev sahipliği yaparak araştırma, akademik ve iş ortamları için özel olarak tasarlanmıştır.

2. Nesil AMD CDNA™ mimarisiyle desteklenen AMD Instinct™ MI200 serisi, zorlu yüksek performanslı bilgi işlem (HPC) ve yapay zeka (AI) iş yüklerinde maksimum verimlilik ve güç tasarrufu için çoklu çip tasarımını kullanır.

Gelişmiş yapay zeka yetenekleriyle, M200 özel sunucunuz derin öğrenme eğitimini ve çıkarımını hızlandırarak yapay zeka tabanlı projeler için güçlü çözümler sunar.

2. nesil CDNA™ mimarisi ve 3. nesil Infinity mimarisine sahip bu sunucular, CPU ve GPU kaynaklarını sorunsuz bir şekilde entegre ederek sistem verimliliğini ve işlem hacmini en üst düzeye çıkarır.

AMD Instinct MI200 serisi hızlandırıcılarla donatılmış sunucular, 8 adede kadar AMD Infinity Fabric™ bağlantısıyla gelişmiş eşler arası bağlantı olanağı sunarak, zorlu iş yükleri için sorunsuz ve verimli veri aktarımı sağlar.

AMD INSTINCT™ GPU'lu özel sunucunuz, HPE Enterprise sunucuları tarafından desteklenmekte olup, en zorlu iş yükleri için istikrarlı performans sağlar.

Sunucu altyapınıza kolayca kaynak veya ek sunucu ekleyin. Çoğu yükseltme işlemi 24 saat içinde tamamlanır.

Alanında uzman sunucu ekibimiz, canlı sohbet ve e-posta yoluyla 7/24 destek sağlamak için hazır bulunmaktadır.

| MI210 | L40S | A100 | H100 | |

|---|---|---|---|---|

| GPU Mimarisi | CDNA 2.0 | Ada Lovelace | NVIDIA Ampere | Hazne |

| GPU Belleği | 64GB HBM2e | 48 GB GDDR6 | 80 GB HBM2e | 80 GB HBM3 |

| GPU Bellek Bant Genişliği | 1638 GB/s | 864 GB/s | 1935 GB/s | 3352 GB/s |

| FP32 | 22,63 TFLOPS | 91,6 TFLOPS | 19,5 TFLOPS | 51 TFLOPS |

| TF32 Tensor Çekirdeği | 312 TFLOPS | 366 TFLOPS | 312 TFLOPS | 756 TFLOPS |

| FP16/BF16 Tensor Çekirdeği | 181 TFLOPS | 733 TFLOPS | 624 TFLOPS | 1513 TFLOPS |

| Güç | 300W'a kadar | 350W'a kadar | 400W'a kadar | 350W'a kadar |

| Yükleniyor... | Yükleniyor... | Yükleniyor... | Yükleniyor... |

Yapay zeka, yüksek performanslı bilgi işlem ve makine öğrenimi iş yükleri için AMD Instinct GPU hızlandırmalı sunucularınızın dağıtımı ve yönetimiyle ilgili sık sorulan sorular.

AMD Instinct GPU'lar, yapay zeka, makine öğrenimi, büyük dil modelleri (LLM'ler) ve yüksek performanslı hesaplama (HPC) iş yükleri için özel olarak tasarlanmış yüksek performanslı hızlandırıcılardır. Derin öğrenme eğitimi ve çıkarımı, bilimsel simülasyonlar, veri analizi ve hesaplamalı araştırmalarda üstün performans gösterirler. CDNA mimarisi, grafik oluşturmadan ziyade hesaplama yoğun paralel işlemeye optimize edilmiştir.

MI300A, AMD'nin en yeni APU'su olup, AMD Instinct hızlandırıcıyı AMD EPYC™ Zen 4 CPU çekirdekleriyle (24 çekirdek) tek bir çip üzerinde birleştirir ve 192 GB HBM3 belleğe ve 3. Nesil AMD Infinity Mimarisine sahiptir. MI200 serisi (MI250X, MI250, MI210), çoklu çip tasarımlı 2. Nesil CDNA mimarisi üzerine kurulu özel GPU hızlandırıcılarıdır. MI300A, CPU-GPU veri aktarım gecikmelerini ortadan kaldıran birleşik bellek mimarisi sunarken, MI200 serisi AMD Infinity Fabric™ bağlantıları aracılığıyla olağanüstü eşler arası bağlantı sağlar.

Anında teslimat sunucuları için AMD Instinct özel sunucunuz, ödeme onaylandıktan sonra genellikle 3-10 dakika içinde etkinleştirilir. Özel yapılandırmalar için dağıtım süresi, donanım kullanılabilirliğine bağlı olarak değişir. Tüm sunucular, destek taleplerini yeniden açmadan hızlı bir şekilde yineleme yapmanıza olanak tanıyan anında işletim sistemi yeniden yükleme özelliklerine sahiptir. Ağ yönlendirmelerimiz, sürekli çalışan iş yükleri ve yüksek verimli veri aktarımı için optimize edilmiştir.

AMD Instinct GPU'lar, AMD'nin GPU hesaplama için açık kaynaklı yazılım platformu olan ROCm (Radeon Open Compute) ile tamamen uyumludur. PyTorch, TensorFlow, JAX ve ONNX Runtime gibi popüler çerçeveleri desteklerler. ROCm, CUDA kodunun kolayca taşınması için HIP (Heterogeneous-Compute Interface for Portability) ile birlikte BLAS, FFT, RNG ve derin öğrenme temelleri için optimize edilmiş kütüphaneler sunar. Platform, ölçeklenebilir yapay zeka/makine öğrenimi dağıtımları için Docker ve Kubernetes ile kapsayıcılaştırılmış iş akışlarını destekler.

AMD Instinct MI300A, veri yoğun iş yükleri için olağanüstü bellek bant genişliğine sahip 192 GB HBM3 (Yüksek Bant Genişlikli Bellek) içerir. MI200 serisi hızlandırıcılar, büyük ölçekli yapay zeka modelleri ve yüksek performanslı bilgi işlem uygulamaları için optimize edilmiş yüksek bant genişlikli HBM2e bellek yapılandırmaları sunar. Bu yüksek bellek kapasitesi, büyük dil modellerinin eğitilmesini, büyük veri kümelerinin işlenmesini ve karmaşık simülasyonların ana bilgisayar ve hızlandırıcı belleği arasında sık veri aktarımı olmadan çalıştırılmasını sağlar.