Performanță excepțională

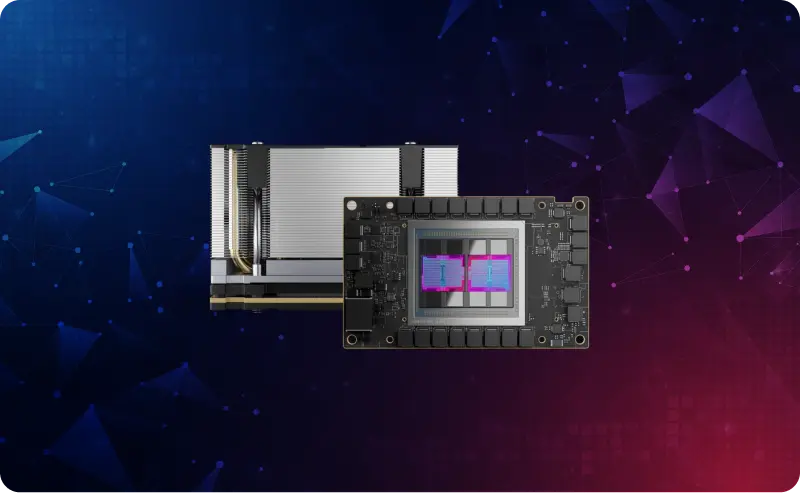

Construit pe arhitectura revoluționară CDNA3, APU-ul MI300A excelează prin furnizarea de performanțe de calcul de neegalat, perfect pentru cele mai solicitante sarcini de lucru de inteligență artificială și HPC.

Optimizează-ți sarcinile de lucru de Machine Learning și LLM cu servere dedicate HPE de nivel enterprise, cu tehnologie AMD Instinct.

Ai configurații GPU pentru servere sau desktopuri inactive? Listează-le astăzi pe piața Primcast și câștigă venituri lunare constante de la echipe de inteligență artificială, dezvoltatori și companii care au nevoie de procesare la nivel de producție.

Special concepute pentru sarcini de lucru bazate pe inteligență artificială, învățare automată și modele lingvistice mari. Serverele noastre GPU AMD Instinct oferă o densitate de calcul excepțională cu memorie HBM3, arhitectură CDNA3 și nuclee CPU Zen 4 pentru aplicații AI/HPC solicitante.

Construit pe arhitectura revoluționară CDNA3, APU-ul MI300A excelează prin furnizarea de performanțe de calcul de neegalat, perfect pentru cele mai solicitante sarcini de lucru de inteligență artificială și HPC.

Integrarea acceleratoarelor AMD Instinct cu nucleele procesorului EPYC™ Zen 4 (24 de nuclee) îmbunătățește eficiența, flexibilitatea și programabilitatea, eliminând în același timp întârzierile în transferul de date.

Alegeți un server de înaltă performanță echipat cu APU-ul AMD Instinct MI300A, adaptat pentru a îndeplini cerințe scalabile, având o capacitate impresionantă de memorie HBM3 de 192 GB.

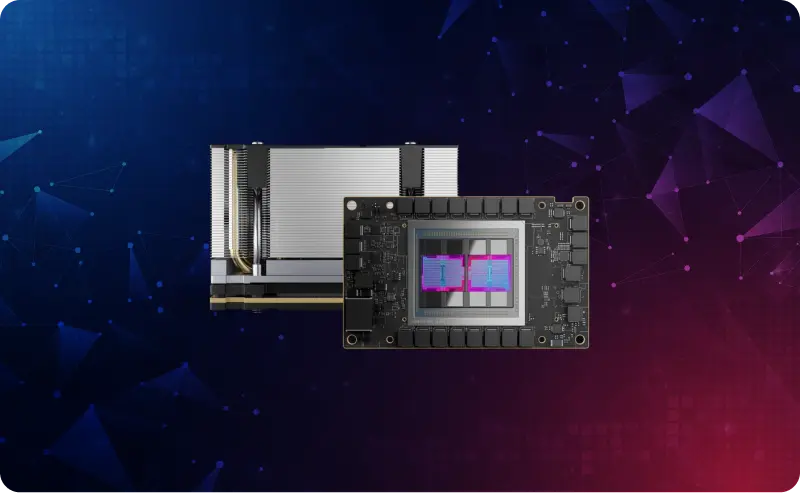

Acceleratoare de înaltă performanță concepute pentru sarcini de lucru HPC și AI exascale

AMD Instinct MI250X este acceleratorul ideal pentru sarcinile de lucru HPC, conceput special pentru era calculului exascale.

Acceleratorul AMD Instinct MI250 oferă performanțe de neegalat pentru aplicațiile HPC și AI, ceea ce îl face un atu neprețuit pentru întreprinderi, instituții de cercetare și academice.

Îmbunătățind capacitățile HPC și AI, acceleratorul AMD Instinct MI210 este adaptat pentru medii de cercetare, academice și de afaceri, găzduind atât soluții single-server, cât și soluții mai mari.

Seria AMD Instinct™ MI200, bazată pe arhitectura AMD CDNA™ de a doua generație, utilizează un design multi-cip pentru un randament maxim și o eficiență energetică în sarcini de lucru HPC și AI solicitante.

Cu capabilități avansate de inteligență artificială, serverul dedicat M200 accelerează antrenamentul și inferența bazate pe deep learning, oferind soluții puternice pentru proiectele bazate pe inteligență artificială.

Dotate cu arhitectura 2nd CDNA™ și arhitectura 3rd Infinity, aceste servere integrează perfect resursele CPU și GPU, maximizând eficiența și debitul sistemului.

Serverele echipate cu acceleratoare din seria AMD Instinct MI200 oferă conectivitate peer-to-peer avansată cu până la 8 legături AMD Infinity Fabric™, asigurând un transfer de date fără probleme și eficient pentru sarcini de lucru solicitante.

Serverul dumneavoastră dedicat cu GPU AMD INSTINCT™ este alimentat de servere HPE Enterprise, asigurând performanțe stabile pentru cele mai solicitante sarcini de lucru.

Adăugați cu ușurință resurse sau servere suplimentare la infrastructura serverelor dvs. Majoritatea actualizărilor sunt procesate în termen de 24 de ore.

Experții în servere dedicate sunt disponibili pentru asistență 24/7 prin chat live și e-mail.

| MI210 | L40S | A100 | H100 | |

|---|---|---|---|---|

| Arhitectura GPU | ADNc 2.0 | Ada Lovelace | NVIDIA Ampere | Pâlnie |

| Memorie GPU | 64 GB HBM2e | 48 GB GDDR6 | 80 GB HBM2e | 80 GB HBM3 |

| Lățime de bandă a memoriei GPU | 1638 GB/s | 864 GB/s | 1935 GB/s | 3352 GB/s |

| FP32 | 22,63 TFLOPS | 91,6 TFLOPS | 19,5 TFLOPS | 51 TFLOPS |

| Nucleu tensor TF32 | 312 TFLOPS | 366 TFLOPS | 312 TFLOPS | 756 TFLOPS |

| Nucleu tensor FP16/BF16 | 181 TFLOPS | 733 TFLOPS | 624 TFLOPS | 1513 TFLOPS |

| Putere | Până la 300W | Până la 350W | Până la 400W | Până la 350W |

| Încărcare... | Încărcare... | Încărcare... | Încărcare... |

Întrebări frecvente despre implementarea și gestionarea serverelor AMD Instinct accelerate prin GPU pentru sarcini de lucru bazate pe inteligență artificială, HPC și învățare automată.

GPU-urile AMD Instinct sunt acceleratoare de înaltă performanță special concepute pentru inteligență artificială, învățare automată, modele lingvistice mari (LLM) și sarcini de lucru de calcul de înaltă performanță (HPC). Acestea excelează în antrenament și inferență în deep learning, simulări științifice, analiză de date și cercetare computațională. Arhitectura CDNA este optimizată pentru procesare paralelă cu utilizare intensivă de calcul, mai degrabă decât pentru randare grafică.

MI300A este cel mai recent APU de la AMD care integrează acceleratorul AMD Instinct cu nucleele CPU AMD EPYC™ Zen 4 (24 de nuclee) pe un singur cip, cu memorie HBM3 de 192 GB și arhitectură AMD Infinity de a 3-a generație. Seria MI200 (MI250X, MI250, MI210) sunt acceleratoare GPU dedicate, construite pe arhitectura CDNA de a 2-a generație cu designuri multi-cip. MI300A oferă o arhitectură de memorie unificată, eliminând întârzierile în transferul de date CPU-GPU, în timp ce seria MI200 oferă conectivitate peer-to-peer excepțională prin legături AMD Infinity Fabric™.

Serverul dumneavoastră dedicat AMD Instinct este de obicei activat în 3-10 minute după efectuarea plății pentru serverele cu livrare instantanee. Pentru configurațiile personalizate, timpul de implementare variază în funcție de disponibilitatea hardware-ului. Toate serverele includ capacități de reîncărcare instantanee a sistemului de operare, permițându-vă să iterați rapid fără a redeschide tichetele de asistență. Rutele noastre de rețea sunt optimizate pentru sarcini de lucru mereu active și transfer de date de mare randament.

GPU-urile AMD Instinct sunt complet compatibile cu ROCM (Radeon Open Compute), platforma software open-source de la AMD pentru calcul GPU. Acestea acceptă framework-uri populare, inclusiv PyTorch, TensorFlow, JAX și ONNX Runtime. ROCM oferă HIP (Heterogeneous-Compute Interface for Portability) pentru migrarea ușoară a codului CUDA, împreună cu biblioteci optimizate pentru primitive BLAS, FFT, RNG și deep learning. Platforma acceptă fluxuri de lucru containerizate cu Docker și Kubernetes pentru implementări scalabile de AI/ML.

AMD Instinct MI300A dispune de 192 GB de memorie HBM3 (High Bandwidth Memory) cu o lățime de bandă excepțională pentru sarcini de lucru cu volum mare de date. Acceleratoarele din seria MI200 oferă configurații de memorie HBM2e cu lățime de bandă mare optimizate pentru modele AI la scară largă și aplicații HPC. Această capacitate mare de memorie permite antrenarea modelelor lingvistice mari, procesarea seturilor de date masive și rularea simulărilor complexe fără transferuri frecvente de date între memoria gazdă și cea a acceleratorului.